在业界对新一代旗舰模子DeepSeek V4的翘首期盼中实盘配资门户网_股票配资论坛问题汇总与规则说明,DeepSeek团队却悄然放出了一篇新的学术论文。

这篇论文由DeepSeek积贮北大、清华共同撰写,将商讨标的投向了决定大模子施行应用落地的关节一环——推理速率,为日益复杂的AI智能体,提供一套高效的底层系统措置有策划。

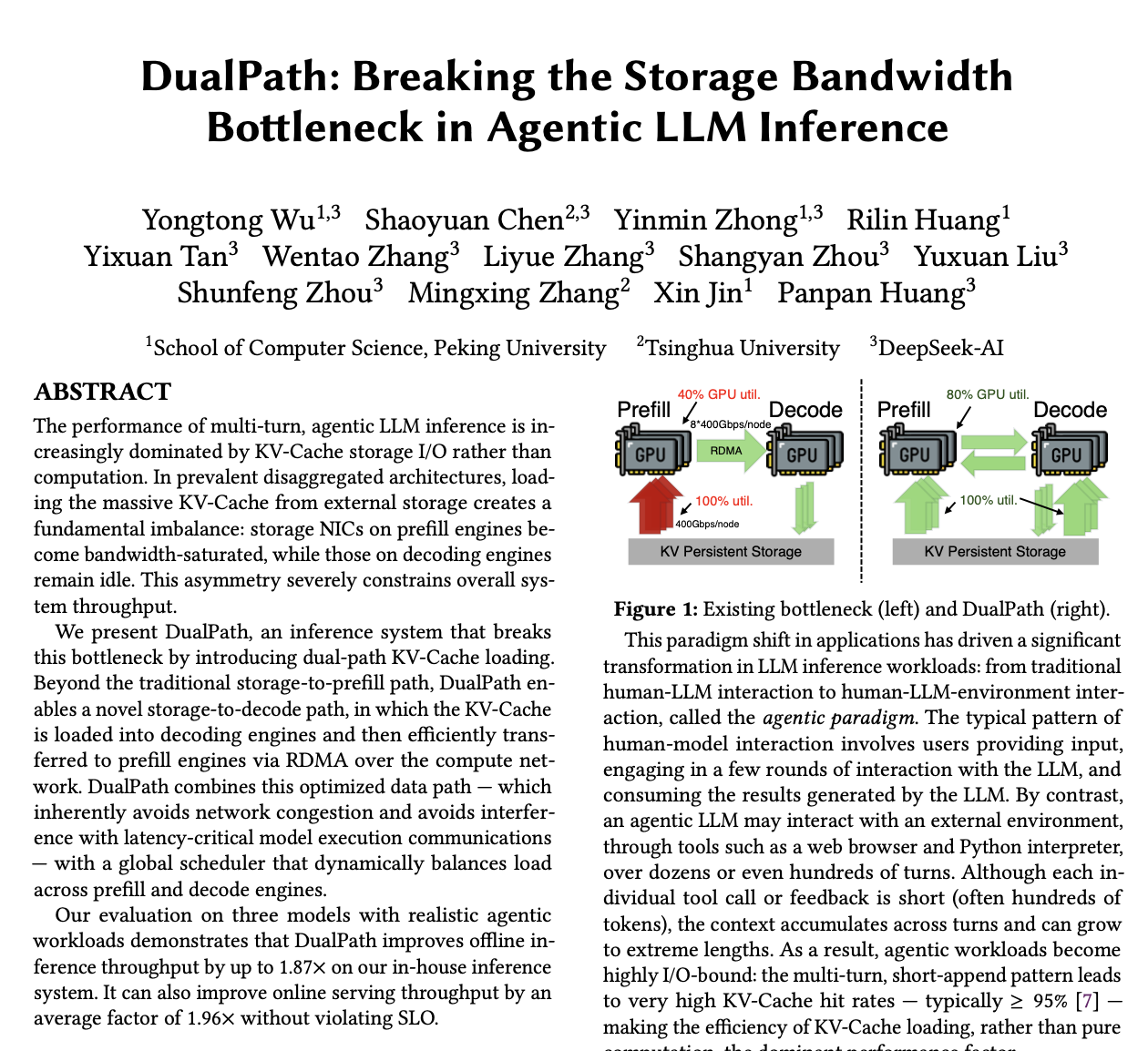

具体来说,新论文先容了一个名为DualPath的立异推理系统,有利针对智能体责任负载下的大模子(LLM)推感性能进行优化。通过引入“双旅途读取KV-Cache(近似记念缓存)”机制,再行分拨存储汇集负载,将离线推理朦拢量最高普及 1.87 倍,在线就业的每秒智能体开动数平均普及 1.96 倍。

论文在引子部分提到,大模子正从单轮对话机器东谈主和零丁推理模子,快速演进为智能体系统 ——大概自主贪图、调用器用,并通过多轮交互措置施行任务。这种应用范式的滚动,推动大模子推理责任负载发生环节变革:从传统的东谈主类-大模子交互,转向东谈主类-大模子-环境交互,交互轮次可达数十致使数百轮。

凹凸文会跨轮次累积,最终长度可能达到极值。此时模子不需要大齐计较,反而需要庸俗从硬盘读取历史凹凸文的 KV-Cache;现存系统中,只消认真预处理的引擎会读取KV-Cache,它的网卡带宽被占满,而认真生成内容的解码引擎,网卡带宽基本闲置,导致通盘系统速率被卡脖子。

因此,论文提议的DualPath,针对智能体责任负载、再行假想当代推理架构中 KV-Cache加载逻辑,措置大模子作念智能体任务时,速率被 “数据读取”拖慢的中枢问题,穷困的是把闲置的带宽资源愚弄起来,相称于给数据读取 “多开了一条高速路”,收场速率的大幅普及。

这一论文适度接续了DeepSeek一贯的作风,在工程化层面将性能优化推向极致。有从业者以为,DeepSeek作念这类优化属于缺显卡的无奈之举,属于“脏活儿累活儿”,全球更期待团队在模子上作念立异。

但也有东谈主以为,即便有饱和显卡,这类优化在缩短老本、缩短token用度方面也很有价值,因为只消饱和低廉,AI智商走向大界限使用。

比拟这篇“求实”的论文,外界显著更柔柔DeepSeek新一代旗舰模子的真面容。对于DeepSeek V4的发布时间,市集据说已几经更替。从领先据说的2月春节前后,到外媒最新报谈的“最快下周”,再到业内东谈主士展望的3月前后,据说链条愈发扑朔迷离。

就在近日,外网有网友爆料称,DeepSeek 正在测试 V4 Lite 模子,代号为“Sealion-lite”,凹凸文窗口为 100万tokens,并原生赈济多模态推理。也有音问说起,DeepSeek已在近期将环节更新版块V4向华为等国内厂商提供提前拜访权,以赈济其优化处理器软件,确保模子在硬件上高效开动。然而,英伟达等厂商尚未取得近似权限。

靠近据说,DeepSeek依旧保握其一贯的千里默,现在并未进行任何复兴。但市集已干预“严阵以待”情景,部分投资机构担忧,新一代模子的发布会如同旧年的版块发布时那样,激勉市集的剧烈颠簸。

举报 第一财经告白互助,请点击这里此内容为第一财经原创,著述权归第一财经悉数。未经第一财经籍面授权,不得以任何格局加以使用,包括转载、摘编、复制或开采镜像。第一财经保留根究侵权者法律职守的职权。如需取得授权请谈判第一财经版权部:banquan@yicai.com 文章作家

刘晓洁

联系阅读 博鳌论坛热议AI智能体元年:爆发背后,风险与料理成新焦点

博鳌论坛热议AI智能体元年:爆发背后,风险与料理成新焦点中国信息通讯商讨院院长余晓晖暗示,企业和平方销耗者悦目尝试新时间,但对新时间也要开采更多的明白和敬畏感。

6 1380 03-26 06:41 你会允许“龙虾”帮你作念交游吗?金融界共寻立异与安全最优解

你会允许“龙虾”帮你作念交游吗?金融界共寻立异与安全最优解金融立异的重中之重是鼎力鞭策东谈主民币海外化。

753 03-24 19:34 国度数据局局长谈“龙虾热”:好智能体应是坦诚的风险讲述者

国度数据局局长谈“龙虾热”:好智能体应是坦诚的风险讲述者到“十五五”末,中国AI联系产业界限将打破10万亿元

1986 03-23 18:56 专访凯文·凯利:还莫得果真的AI巨匠出现!

专访凯文·凯利:还莫得果真的AI巨匠出现!咱们需要差别科学和科幻,并领导那些饱读舞“百岁东谈主生不是梦”或者“咱们很快就能收场‘上载腾达’致使收场长生”的东谈主,“上载腾达”依然科学幻念念,改日100年内齐不成能收场!

1593 03-22 15:38 梁文锋曾婉拒投资,陈天桥砸十亿好意思元躬行下场!已投超百个AI边幅

梁文锋曾婉拒投资,陈天桥砸十亿好意思元躬行下场!已投超百个AI边幅AI不应该仅仅通过展望下一个词该说什么来“写”出谜底实盘配资门户网_股票配资论坛问题汇总与规则说明,而应该通过不雅察果真寰宇来“推导”出谜底。他但愿打造一个能像科学家相通追寻真相、逻辑严实、不出短处的“理智大脑”。

6 185 03-19 14:17 一财最热 点击关闭实盘配资门户网_股票配资论坛问题汇总与规则说明提示:本文来自互联网,不代表本网站观点。